Premiera Mistral 3, najnowszej rodziny modeli językowych od francuskiej firmy Mistral AI, to jedno z najważniejszych wydarzeń w świecie sztucznej inteligencji. Modele te, udostępnione na otwartej licencji Apache 2.0, stanowią przełom, oferując multimodalne i wielojęzyczne możliwości, które skutecznie konkurują z zamkniętymi systemami największych graczy rynkowych [1].

Dla firm i deweloperów w Polsce, Mistral 3 otwiera nowe możliwości w zakresie automatyzacji, optymalizacji pod kątem wyszukiwarek (SEO) oraz tworzenia zaawansowanych aplikacji biznesowych. W tym artykule przeprowadzimy dogłębną analizę nowej generacji modeli, wyjaśniając, czym jest Mistral 3, jak działa i w jaki sposób można go wykorzystać w praktyce.

1. Co to jest Mistral 3? Architektura i Rodzina Modeli

Mistral 3 to nie jeden model, lecz cała rodzina, zaprojektowana z myślą o pokryciu pełnego spektrum zastosowań – od urządzeń brzegowych (edge devices) po centra danych. Kluczową cechą tej rodziny jest jej otwarty charakter (licencja Apache 2.0), co daje użytkownikom pełną kontrolę i możliwość dostosowania modeli do własnych potrzeb [1].

Rodzina Mistral 3 dzieli się na dwie główne kategorie:

A. Ministral 3 (Modele Gęste)

Są to mniejsze, gęste modele, zoptymalizowane pod kątem wydajności i kosztów. Idealnie nadają się do lokalnego uruchamiania (np. na laptopach, dronach, urządzeniach IoT) oraz do zadań wymagających szybkiej inferencji.

| Model | Liczba Parametrów | Architektura | Zastosowanie |

|---|---|---|---|

| Ministral 3B | 3 miliardy | Gęsta | Urządzenia brzegowe, szybka inferencja, niskie zużycie pamięci. |

| Ministral 8B | 8 miliardów | Gęsta | Lokalna inferencja, aplikacje mobilne, optymalny stosunek wydajności do kosztów. |

| Ministral 14B | 14 miliardów | Gęsta | Zaawansowane zadania lokalne, wdrożenia na pojedynczych GPU. |

B. Mistral Large 3 (Model Sparse MoE)

Mistral Large 3 to flagowy model nowej generacji i najbardziej zaawansowany model firmy Mistral AI do tej pory. Został on wytrenowany od podstaw na 3000 procesorów graficznych NVIDIA H200 [1].

- Architektura: Wykorzystuje architekturę Sparse Mixture-of-Experts (MoE), która pozwala na osiągnięcie wydajności dużego modelu przy jednoczesnym utrzymaniu niższych kosztów inferencji.

- Parametry: Posiada 41 miliardów aktywnych parametrów z 675 miliardów całkowitych parametrów.

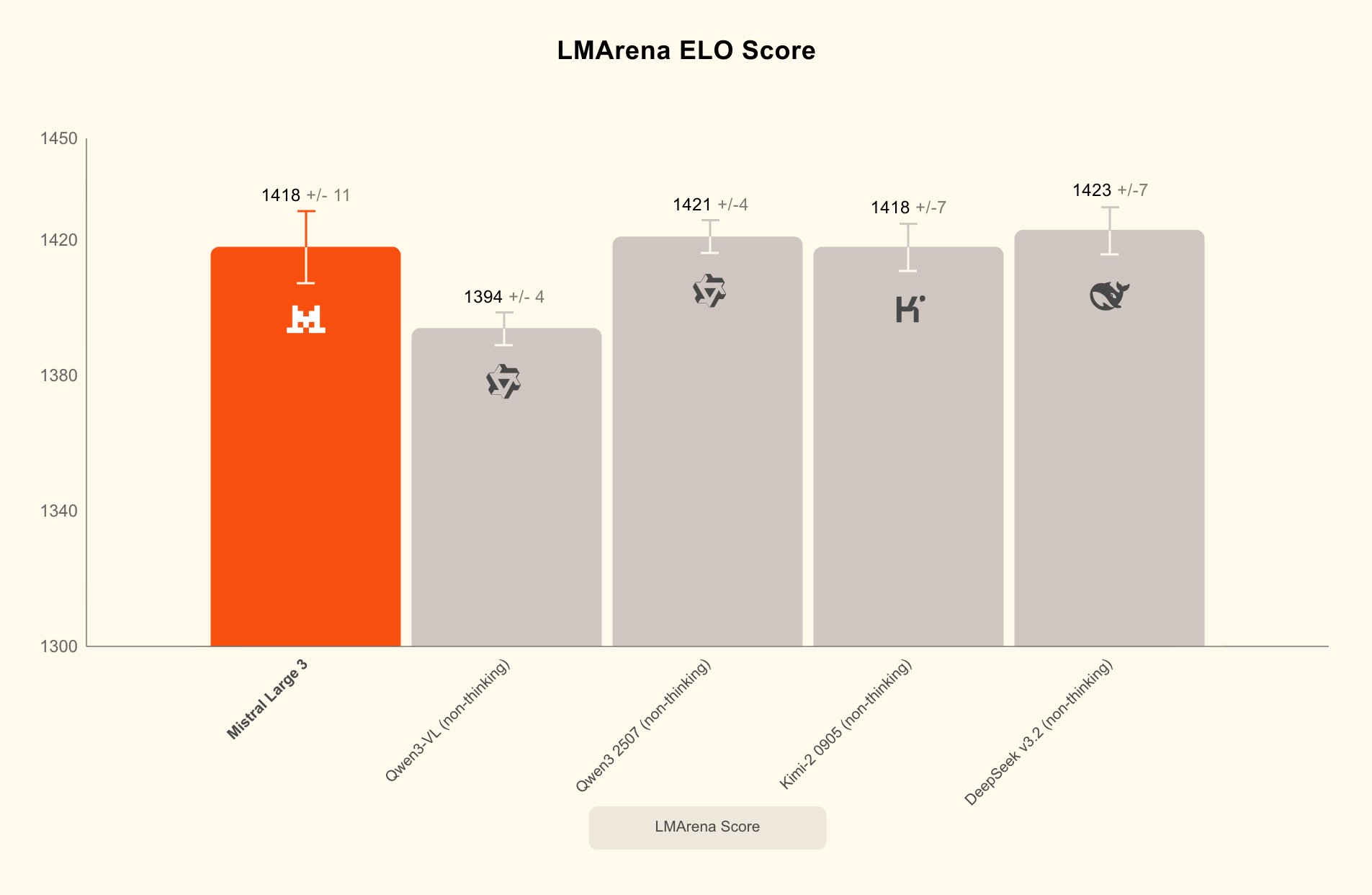

- Wydajność: Osiąga wyniki porównywalne z najlepszymi zamkniętymi modelami na rynku, szczególnie wyróżniając się w wielojęzycznych konwersacjach (poza angielskim i chińskim) oraz w rozumieniu obrazów (multimodalność) [1].

Ilustracja 1: Porównanie wydajności Mistral Large 3 na tle konkurencji (LMArena ELO Score)

Źródło: LMArena, na podstawie danych z ogłoszenia Mistral 3 [1].

2. Jak działa Mistral 3? Kluczowe Innowacje

Kluczem do wyjątkowej wydajności Mistral 3 jest połączenie zaawansowanej architektury z optymalizacją sprzętową.

Sparse Mixture-of-Experts (MoE)

Architektura MoE, zastosowana w Mistral Large 3, polega na tym, że model składa się z wielu „ekspertów” (sieci neuronowych). Dla każdego tokena wejściowego, tylko niewielka część tych ekspertów jest aktywowana. Dzięki temu model może być ogromny (675B parametrów), ale koszt obliczeniowy (aktywne 41B) jest znacznie niższy niż w przypadku tradycyjnego, gęstego modelu o tej samej liczbie parametrów [2].

Wielojęzyczność i Multimodalność

Mistral 3 został zaprojektowany jako model wielojęzyczny (ponad 40 języków) i multimodalny, co oznacza, że potrafi przetwarzać i rozumieć zarówno tekst, jak i obrazy. Ta cecha jest szczególnie istotna dla globalnych i lokalnych zastosowań, w tym dla rynku polskiego, gdzie precyzyjne rozumienie kontekstu językowego jest kluczowe.

Optymalizacja Sprzętowa

Modele Mistral 3 zostały zoptymalizowane we współpracy z firmą NVIDIA, co zapewnia ich efektywne działanie na różnych platformach – od centrów danych (GB200 NVL72) po urządzenia brzegowe (Jetson) [1]. Ta optymalizacja przekłada się na szybszą inferencję i niższe koszty operacyjne.

3. Jak korzystać z Mistral 3? Zastosowania w SEO i Biznesie

Otwarty charakter i wysoka wydajność Mistral 3 sprawiają, że jest to idealne narzędzie do zastosowań komercyjnych, zwłaszcza w kontekście optymalizacji treści pod kątem polskiego SEO.

A. Dostęp i Wdrożenie

Mistral 3 jest dostępny na wiele sposobów [1]:

- Mistral AI Studio: Bezpośredni dostęp przez API.

- Platformy Chmurowe: Dostępny m.in. na Amazon Bedrock, Azure Foundry, IBM WatsonX.

- Open-Source: Modele Ministral 3 i Mistral Large 3 są dostępne na platformach takich jak Hugging Face, co umożliwia lokalne wdrożenie i pełną kontrolę nad danymi.

B. Mistral 3 a Polskie SEO i Geo-Targeting

Modele Mistral AI, w tym najnowszy Mistral 3, są cenione za ich zdolność do generowania wysokiej jakości treści w językach innych niż angielski. To czyni je potężnym narzędziem dla polskiego rynku SEO [3].

| Zastosowanie w SEO | Korzyści z Mistral 3 |

|---|---|

| Badanie Słów Kluczowych | Generowanie bardziej precyzyjnych i kompleksowych list słów kluczowych, uwzględniających lokalne warianty i intencje użytkowników [3]. |

| Generowanie Treści | Tworzenie długich, eksperckich artykułów, opisów produktów i meta-opisów, które są naturalne i zoptymalizowane pod kątem wyszukiwarek. |

| Geo-Targeting | Lepsze rozumienie i generowanie treści z uwzględnieniem lokalnego kontekstu i fraz geograficznych (np. „najlepszy [usługa] w [miasto]”). |

| Automatyzacja | Automatyzacja powtarzalnych zadań SEO, takich jak audyty treści, grupowanie tematów czy generowanie skryptów [4]. |

Praktyczne Wskazówki:

Korzystanie z Mistral 3 przez API (np. za pomocą Pythona) pozwala na masowe generowanie treści i integrację z istniejącymi systemami zarządzania treścią (CMS) lub narzędziami SEO [4]. Otwarty charakter modelu umożliwia również jego dostrajanie (fine-tuning) na własnych, specyficznych dla branży lub regionu, zbiorach danych, co dodatkowo zwiększa jego skuteczność w polskim kontekście biznesowym.

Podsumowanie

Mistral 3 to przełomowa premiera, która umacnia pozycję Mistral AI jako lidera w dziedzinie otwartych modeli językowych. Oferując rodzinę modeli od lekkich (Ministral) po flagowy, multimodalny i wielojęzyczny Mistral Large 3, firma dostarcza narzędzia, które są zarówno potężne, jak i dostępne.

Dla polskiego rynku, ta nowa generacja AI oznacza możliwość tworzenia bardziej zaawansowanych, zoptymalizowanych i wiarygodnych treści, co jest kluczowe w dynamicznym świecie SEO i biznesu. Otwartość i elastyczność Mistral 3 sprawiają, że przyszłość AI jest w rękach deweloperów i przedsiębiorców, którzy mogą teraz budować własne, niestandardowe rozwiązania.

Źródła (References)

[1] Mistral AI. (2025). Introducing Mistral 3. [https://mistral.ai/news/mistral-3]

[2] Hugging Face. (2025). mistralai/Ministral-3-14B-Base-2512. [https://huggingface.co/mistralai/Ministral-3-14B-Base-2512]

[3] SEO-WWW.PL. (b.d.). Mistral AI – czym jest i jak wykorzystać go pod SEO?. [https://seo-www.pl/blog/mistral-ai-czym-jest-i-jak-wykorzystac-go-pod-seo/]

[4] Michał Małysa. (2024). Mistral API krok po kroku. Klucz, koszty i skrypt Python. [https://michalmalysa.pl/mistral-api-krok-po-kroku/]